Czas eksperymentów w IT dobiegł końca. Nadchodzi era inwestycji z mierzalną stopą zwrotu. W naszym trendbooku analizujemy jak FinOps, Composable Enterprise, Data Mesh, Edge Computing oraz AI-Driven QA przekształcą bankowość, retail i przemysł – z naciskiem na konkretne efekty biznesowe, a nie tylko na listę technologii.

2026: od „innowacji dla innowacji” do ery efektywności technologicznej

Nadchodzący rok może okazać się przełomowy dla rozwoju IT w biznesie. Po ponad dekadzie intensywnych inwestycji w chmurę, AI i cyfrową transformację, organizacje wchodzą w fazę „efektywności technologicznej”. Coraz mniej akceptowalne są projekty, które trudno powiązać z P&L – oczekuje się jasnego, policzalnego wpływu na przychody, koszty lub ryzyko. Globalne analizy pokazują, że zespoły Enterprise Architecture i CIO są dziś rozliczane nie z liczby wdrożonych systemów, lecz z racjonalizacji portfolio, redukcji długu technologicznego i budowy kompozytowych architektur, które zwiększają zwinność przy kontrolowanym koszcie. (gartner.com)

W tym kontekście liderzy IT w bankowości, retailu i przemyśle muszą odpowiedzieć na dwa proste, ale wymagające pytania:

1. Jak dostarczać nowe funkcjonalności szybciej i bezpieczniej?

2. Jak robić to taniej i efektywniej – przy zachowaniu zgodności i jakości? Poniżej analizujemy kluczowe kierunki na 2026 rok, pokazując nie tylko trendy, ale też konsekwencje dla decyzji inwestycyjnych oraz praktyczne kroki, które warto rozważyć.

1 . Architektura: Composable Enterprise – szybkość działania vs. ryzyko

W 2026 roku monolit ostatecznie ustępuje miejsca Composable Enterprise, które przestaje być hasłem z konferencji, a staje się praktycznym kierunkiem modernizacji systemów. Mówimy nie tylko o mikroserwisach, lecz o strategicznym budowaniu systemów z Packaged Business Capabilities (PBCs) – modułów reprezentujących konkretne zdolności biznesowe (np. rozliczenia, scoring, koszyk, program lojalnościowy). Szacunki analityczne pokazują, że udział aplikacji budowanych w oparciu o PBC stale rośnie. Composable pozwala na 30% szybsze wdrażanie nowych funkcjonalności i kanałów sprzedaży (Gartner, Top Trends in Data & Analytics (D&A)), a to głównie dzięki: mniejszemu zakresowi zmian przy wdrożeniu nowej funkcji, możliwości niezależnego skalowania wybranych domen, łatwiejszemu zastępowaniu elementów, które przestają wspierać cele biznesowe.

Dla sektora bankowego oznacza to szybszą adaptację do nowych wymogów regulacyjnych i produktów (np. zmiany w scoringu, nowe typy rachunków czy integracje płatnicze). W retailu i e-commerce – możliwość równoległego rozwijania kanałów sprzedaży, promocji i programów lojalnościowych bez zatrzymywania całej platformy.

Praktyczny kierunek działania:

- Zamiast przepisywać cały system, organizacja identyfikuje 3–5 kluczowych domen (np. płatności, koszyk, lojalność, katalog, promocje) i wydziela je jako PBC.

- Wdrożenie Headless Commerce lub Headless CMS pozwala odseparować logikę biznesową od warstwy prezentacji, co znacząco przyspiesza eksperymenty w kanałach digital.

2. Jakość hiperautomatyzacji QA – od „Shift Left” do predykcji defektów

Kultura Shift Left stała się standardem – testy włączamy jak najwcześniej w cykl wytwórczy. W 2026 roku prawdziwym wyróżnikiem będzie jednak Hyperautomation w QA, w której:

- AI analizuje historię defektów, logi i metryki jakości,

- automatycznie priorytetyzuje scenariusze wysokiego ryzyka,

- przewiduje miejsca, w których błąd jest najbardziej prawdopodobny (Defect Prediction).

Badania rynku pokazują, że organizacje korzystające z AI-driven defect prediction i riskbased testing raportują skrócenie cykli testowych i time-to-release o ok. 15–25%, przy jednoczesnym ograniczeniu liczby krytycznych defektów wychwytywanych dopiero na produkcji.

Praktyczny kierunek działania:

- Budowa repozytorium danych testowych (wyniki testów, logi, metryki CI/CD) jako źródła dla modeli ML.

- Włączenie AI do selekcji testów regresyjnych – zamiast uruchamiać wszystko, uruchamiamy najbardziej ryzykowne ścieżki.

- Zintegrowanie SAST/DAST oraz testów bezpieczeństwa z pipeline’ami CI/CD – z raportowaniem ryzyka w czasie zbliżonym do rzeczywistego.

Pytania kontrolne dla organizacji:

- Czy jesteśmy w stanie odpowiedzieć, które fragmenty systemu generują najwięcej defektów i dlaczego?

- Jak duża część testów automatycznych jest realnie wykorzystywana, a ile to „szum” w pipeline’ach?

- Czy nasze testy bezpieczeństwa są traktowane tak samo priorytetowo jak testy funkcjonalne?

3. Dane: od Big Data do Data Mesh i „Data Products”

W dobie AI głównym problemem nie jest już ilość danych, lecz architektura ich zarządzania – a dostęp do rzetelnych i oczyszczonych danych staje się prawdziwym paliwem dla organizacji. Rzetelność ta wynika nie tylko z poprawności źródeł, ale także z procesów oczyszczania, standaryzacji i kontroli jakości danych na każdym etapie ich życia. W sektorach regulowanych, takich jak finanse czy healthcare, rośnie zainteresowanie Data Mesh – podejściem, w którym dane są traktowane jak produkt, zarządzany przez domenowe zespoły odpowiedzialne za pełny cykl życia danych.

W finansach Data Mesh umożliwia niezależnym pionom (kredyty, ryzyko, compliance) szybsze i bezpieczniejsze udostępnianie danych do celów regulacyjnych i analitycznych, a w healthcare gwarantuje lepszy Data Governance oraz zgodność z RODO, SOC 2 i CCPA.

Korzyści z Data Mesh w regulowanych sektorach:

- lepsza skalowalność raportowania regulacyjnego,

- szybsze udostępnianie danych analitykom i zespołom AI przy zachowaniu kontroli dostępu,

- silniejsze osadzenie odpowiedzialności za dane w biznesie (a nie tylko w centralnym BI/IT).

- wyższa jakość danych – efektem standaryzacji, oczyszczania, kontroli rodowodu danych i bieżącej walidacji na poziomie domen.

Praktyczny kierunek działania:

- Identyfikacja 2–3 domen, w których „wąskie gardła” danych najbardziej hamują projekty (np. regulatory reporting, fraud, customer 360).

- Powołanie domenowych zespołów data (Data Owner + inżynierowie + analitycy), odpowiedzialnych za Data Products.

- Zdefiniowanie standardów Data Governance (linie rodowodu danych, klasyfikacja wrażliwości, polityki dostępu).

Pytania kontrolne dla organizacji:

- Czy mamy jasno określonych właścicieli biznesowych dla kluczowych zbiorów danych?

- Ile czasu mija od potrzeby raportu / treningu modelu AI do uzyskania dostępu do danych?

- Czy jesteśmy w stanie wytłumaczyć regulatorowi, skąd pochodzą konkretne dane w raporcie?

- W jaki sposób nasze systemy reagują na „prawo do zapomnienia” – czy potrafimy skutecznie usunąć dane użytkownika we wszystkich domenach i systemach, bez naruszania integralności pozostałych danych?

4. FinOps i GreenOps: optymalizacja kosztów chmury zamiast cięcia projektów

Fakt, że chmura obliczeniowa może w ostatecznym rozrachunku efektywniejsza finansowo od infrastruktury On-Premise jest oczywisty. Nie zmienia to faktu, że chmurę obliczeniową również należy odpowiednio zoptymalizować. Największym wyzwaniem jest przekształcenie jej z kosztu operacyjnego (OpEx) w inwestycję z mierzalnym ROI. FinOps (Cloud Financial Operations) staje się obecnie standardem operacyjnym. Skąd czerpać oszczędności? Analizy pokazują, że aktywne wdrożenie FinOps prowadzi do oszczędności 15% do 30% w budżetach chmurowych (McKinsey, The FinOps way: How to avoid the pitfalls to realizing cloud’s value). Nie chodzi tylko o negocjacje z dostawcami, ale o zmianę kultury – deweloperzy muszą być świadomi kosztów zasobów, które konsumują. GreenOps uzupełnia ten obraz, włączając do metryk oszczędności również zrównoważony rozwój.

Praktyczny kierunek działania:

- Zbudowanie przejrzystej kostki kosztowej – kto i w jakim celu konsumuje zasoby chmurowe (tagowanie, chargeback/showback).

- Ustalenie zasad współodpowiedzialności za koszty między IT, biznesem i finansami („shared responsibility” dla budżetu chmurowego).

- Automatyzacja wyłączania nieużywanych środowisk (dev/test) oraz dopasowywania mocy (rightsizing, autoscaling). Dodanie metryk związanych ze śladem węglowym i efektywnością energetyczną do kokpitów FinOps.

Pytania kontrolne dla organizacji:

Czy potrafimy wskazać top 10 najbardziej kosztownych usług chmurowych i ich właścicieli biznesowych? Czy deweloperzy widzą realny koszt uruchamianych przez siebie zasobów? W jaki sposób raportujemy wpływ środowiska chmurowego na cele ESG?

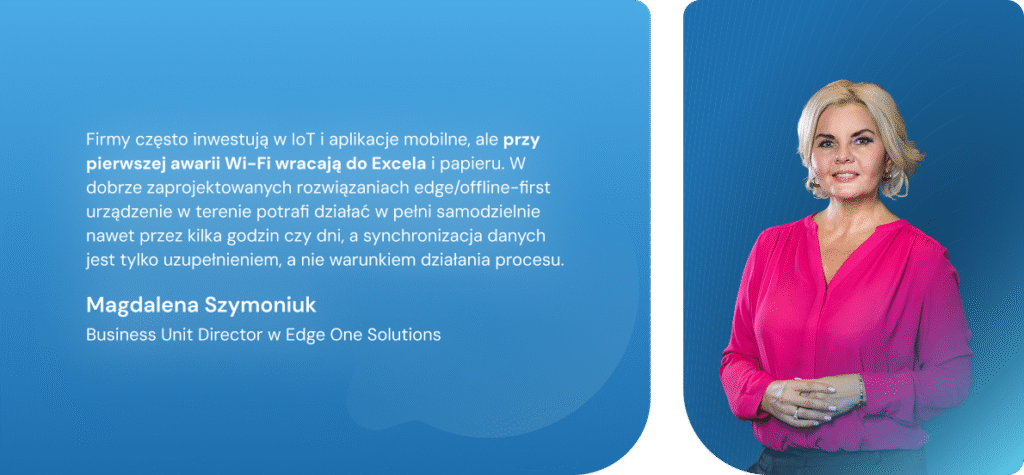

5. Rosnąca rola Edge Computingu

Aplikacje mobilne dla B2B opuszczają centralną chmurę, aby działać na brzegu sieci (Edge Computing). Jest to krytyczne dla sektorów, w których opóźnienia sieciowe są niedopuszczalne.

Gdzie kryje się problem? W produkcji i przemyśle analityka na brzegu infrastruktury IT pozwala na decyzje w czasie rzeczywistym (np. predykcyjne utrzymanie maszyn, natychmiastowa kontrola jakości obrazu). Ekosystem uzupełniają aplikacje Offline-First gwarantujące ciągłość procesów w magazynach i na halach produkcyjnych, gdzie łączność jest niestabilna.

Praktyczny kierunek działania:

- Przeniesienie krytycznej logiki biznesowej (np. check-listy serwisowe, skanowanie towaru, wstępna analiza danych z sensorów) na urządzenia brzegowe lub mobile.

- Zaprojektowanie solidnego mechanizmu synchronizacji danych (kolejki, konflikt resolution, szyfrowanie danych lokalnych).

- Wyraźne rozdzielenie: co musi działać offline, a co może poczekać na synchronizację z centralnym systemem.

Pytania kontrolne dla organizacji:

- Ile naszych procesów operacyjnych zatrzymuje się w momencie utraty łączności?

- Czy mamy zmapowane scenariusze „degradacji funkcji” – co dzieje się z aplikacją, gdy sieć jest niedostępna?

- Jaką część danych rzeczywiście trzeba wysyłać do chmury w czasie rzeczywistym?

6. Zarządzanie projektami w 2026 roku: dominacja modeli hybrydowych zamiast „czystego” Agile i Waterfall

W 2026 roku w organizacjach B2B coraz rzadziej spotyka się projekty prowadzone w czystych metodykach Scrum lub Waterfall. Rosnąca presja regulacyjna, potrzeba precyzyjnej kontroli kosztów, oraz jednoczesna konieczność szybkiego dostarczania wartości powodują, że modele hybrydowe stają się standardem. Firmy łączą elementy Agile z komponentami Waterfalla w taki sposób, aby wykorzystać: elastyczność iteracyjnego dostarczania, przewidywalność budżetu i zakresu, oraz spójne mechanizmy governance, wymagane na poziomie PMO, audytu i compliance.

Jak wyglądają nowoczesne modele hybrydowe?

1. Stabilna dokumentacja wymagań + iteracyjne rozwijanie produktu

W klasycznym Waterfallu lista wymagań jest zamrożona i opisana w formie dokumentacji (BRD/FRD). W hybrydzie przyjmuje się model, w którym organizacja definiuje wstępnie stabilny zakres biznesowy na wysokim poziomie, a zespoły wytwórcze pracują iteracyjnie, z backlogiem zarządzanym w sposób zwinny.

To nie „stały backlog w Waterfallu”, lecz stabilna baza wymagań, która pełni funkcję wejścia dla iteracyjnych sprintów i cykli wytwórczych.

2. Różne modele kontraktowe w jednym projekcie

Firmy łączą: Fixed Price dla komponentów o dobrze zdefiniowanym zakresie, Time & Material dla obszarów innowacyjnych lub wymagających eksperymentów, Managed Services dla stabilnych obszarów utrzymaniowych. Takie hybrydy wymagają silnego zarządzania zakresem, ryzykiem oraz procesem zmian, aby uniknąć konfliktów między modelem stałej ceny a zmiennym środowiskiem Agile.

3. PMO zarządza portfelem w modelu mieszanym

Nowoczesne PMO nie narzuca jednej metodologii. Zamiast tego: część inicjatyw jest prowadzona jako produkty, z PO odpowiedzialnymi za wartość biznesową, część jako klasyczne projekty, z wyraźnym budżetem, zakresem i harmonogramem, a wszystkie są oceniane według wspólnej logiki governance. To wymaga spójnych procesów raportowania: nie tylko statusu i kosztów, ale także wpływu biznesowego.

4. Ewolucja roli Product Ownera / Product Managera

Rola PO przesuwa się od zarządzania backlogiem w stronę zarządzania wartością. W praktyce oznacza to: udział w tworzeniu KPI biznesowych, odpowiedzialność za ROI funkcjonalności, współpracę z PMO i biznesem przy priorytetyzacji portfela, większy nacisk na analizę danych (adopcja, wpływ na procesy, metryki użytkowania). W wielu organizacjach PO staje się faktycznie Value Ownerem, pracującym ponad klasycznymi ramami Scruma.

Praktyczne kierunki działania dla organizacji

1. Wprowadzenie metryk biznesowych na poziomie inicjatyw

Zamiast prób „przepychać” KPI biznesowe do Definition of Done (co nie zawsze jest realistyczne), firmy stosują model: hipoteza – eksperyment – pomiar – decyzja, KPI biznesowe przypięte do celów sprintów, epiców lub release’ów, analiza wpływu po określonym czasie (np. 30/60/90 dni). Takie podejście pozwala na iteracyjne zwiększanie wartości.

2. Jasne reguły wyboru metodyki i modelu współpracy

Organizacja powinna mieć standard oceny inicjatyw, który uwzględnia:

- dojrzałość wymagań,

- poziom ryzyka,

- złożoność integracji,

- oczekiwaną szybkość dowozu,

- wymagania regulacyjne.

Efektem jest jednoznaczna decyzja czy inicjatywa idzie w: Agile, Waterfall, czy model hybrydowy (i jaki jego wariant).

3. Governance dopasowany do hybrydy (najczęściej brakujący element)

Wiele organizacji wdraża hybrydę na poziomie ceremonii, ale zapomina o zarządzaniu. Tymczasem to governance odpowiada za spójność.

Kluczowe elementy:

- zdefiniowane role PM / PO / Business Owner,

- proces Stage-Gate na poziomie portfela,

- spójne artefakty (vision, roadmap, release plan, status report),

- zasady podejmowania decyzji o zmianach zakresu, przejrzyste procesy eskalacji.

- Brak governance – hybryda degeneruje się w chaos.

Pytania kontrolne, które powinna zadać sobie każda organizacja:

Czy nasz obecny model dostarczania jest odpowiedzią na rzeczywiste potrzeby biznesowe i regulacyjne, czy po prostu kontynuacją dawnych praktyk?

W jaki sposób mierzymy efektywność sprintów i releasów — liczbą story points czy realnym wpływem na KPI biznesowe?

Czy nasz PMO potrafi zarządzać jednym portfelem, w którym współistnieją projekty Agile, Waterfallowe i hybrydowe?

Czy governance wspiera zespoły w elastyczności, zamiast ją tłumić?

Czy wybór metodyki dla każdej inicjatywy jest świadomą decyzją, a nie domyślnym rozwiązaniem?

7. AI, Gen AI oraz hiperpersonalizacja

Nie wolno zapominać o stale rozpędzającym się pociągu rozwiązań wykorzystujących narzędzia sztucznej inteligencji. Po początkowej fazie wdrożenia algorytmów AI, nadszedł czas na znacznie bardziej rozbudowane rozwiązania wykorzystujące generatywną sztuczną inteligencję. GenAI przechodzi od czysto eksperymentalnych chatbotów do roli generatywnych agentów decyzyjnych w krytycznych procesach B2B.

Generatywna sztuczna inteligencja sprzyja również hiper-personalizacji. Pozwala bowiem na segmentację i personalizację ofert dla klientów B2B w czasie rzeczywistym. W retailu wspiera to dobór optymalnego asortymentu; w finansach – dynamiczne modelowanie ryzyka.

Nie wolno zapominać również o zaadresowaniu ryzyka. Kluczowe staje się wprowadzenie mechanizmów AI Governance i audytu modeli, aby zapewnić etyczne wykorzystanie i unikać ryzyka halucynacji w krytycznych dla biznesu danych.

8. Środowisko IT w 2026 roku – od innowacji do mierzalnej efektywności z wykorzystaniem nowoczesnych rozwiązań

Na podstawie analizy trendów można wskazać trzy strategiczne obszary, które decydenci powinni zaadresować w pierwszej kolejności:

- Kontrola kosztów i optymalizacja infrastruktury – rozwój praktyk FinOps/GreenOps, racjonalizacja portfolio aplikacji, świadome decyzje o tym, co trafia do chmury, a co na edge.

- Adaptacyjna architektura umożliwiająca szybkie zmiany – Composable Enterprise, PBCs, podejście API-first i headless; hybrydowe modele zarządzania projektami, które łączą przewidywalność z elastycznością.

- Dane i AI jako realne źródło wartości biznesowej – Data Mesh i Data Governance w sektorach regulowanych, AI-driven QA i automatyzacja, GenAI i hiperpersonalizacja osadzone w procesach operacyjnych.

Kierunek na 2026 rok jest jasny: IT musi ostatecznie przestać być postrzegane jako centrum kosztów, a stać się akceleratorem mierzalnej efektywności i wzrostu.

Sukces odniosą te organizacje, które:

- połączą FinOps z Composable Enterprise,

- oprą AI i GenAI na solidnych fundamentach danych (Data Mesh, Governance),

- zautomatyzują jakość (Hyperautomation QA) i przeniosą przetwarzanie tam, gdzie faktycznie powstaje wartość – na produkcję, do magazynu, do urządzeń klientów (Edge & Offline-First).

Posiadanie najnowszych narzędzi to dopiero początek. Prawdziwym wyzwaniem 2026 roku będzie operacjonalizacja i integracja tych technologii w skali całej organizacji – tak, aby każdy projekt miał jasno określony cel biznesowy, mierzalne KPI i uzasadniony zwrot z inwestycji.